Создание самого файла

Robots.txt – это файл с инструкциями для поисковых роботов. Он создается в корне сайта. Вы можете прямо сейчас создать его на своем рабочем столе при помощи блокнота, как создается любой текстовый файл.

Для этого жмем правой кнопкой мыши по пустому пространству, выбираем Создать – Текстовый документ (не Word). Он откроется с помощью обычного блокнота. Назовите его robots, расширение у него и так уже правильное – txt. Это все, что касается создания самого файла.

Как составить robots.txt

Теперь остается заполнить файл нужными инструкциями. Собственно, у команд для роботов простейший синтаксис, намного проще, чем в любом языке программирования. Вообще заполнить файл можно двумя способами:

Посмотреть у другого сайта, скопировать и изменить под структуру своего проекта.

Написать самому

О первом способе я уже писал в . Он подходит, если у сайтов одинаковые движки и нет существенной разницы в функционале. Например, все сайты на wordpress имеют одинаковую структуру, однако могут быть различные расширения, вроде форума, интернет-магазина и множества дополнительных каталогов. Если вы хотите знать, как изменить robots.txt читайте эту статью, можно также ознакомиться с предыдущей, но и в этой будет сказано достаточно много.

Например, у вас на сайте есть каталог /source, где хранятся исходники к тем статьям, что вы пишите на блог, а у другого веб-мастера нет такой директории. И вы, к примеру, хотите закрыть папку source от индексации. Если вы скопируете robots.txt у другого ресурса, то там такой команды не будет. Вам придется дописывать свои инструкции, удалять ненужное и т.д.

Так что в любом случае полезно знать основы синтаксиса инструкций для роботов, который вы сейчас и разберем.

Как писать свои инструкции роботам?

Первое, с чего начинается файл, это с указания того, к каким именно поисковым машинам обращены инструкции. Это делается так:

User-agent: Yandex Или User-agent: Googlebot

User - agent : Yandex User - agent : Googlebot |

Никаких точек с запятой в конце строчки ставить не нужно, это вам не программирование). В общем, тут понятно, что в первом случае инструкции будет читать только бот Яндекса, во втором – только Гугла. Если команды должны быть выполнены всеми роботами, пишут так: User-agent:

Отлично. С обращением к роботам мы разобрались. Это несложно. Вы можете представить это на простом примере. У вас есть трое младших братьев, Вася, Дима и Петя, а вы главный. Родители ушли и сказали вам, чтобы вы следили за ними.

Все трое чего-то просят у вас. Представь, что нужно дать им ответ так, как будто пишешь инструкции поисковым роботам. Это будет выглядеть примерно так:

User-agent: Vasya Allow: пойти на футбол User-agent: Dima Disallow: пойти на футбол (Дима в прошлый раз разбил стекло соседям, он наказан) User-agent: Petya Allow: сходить в кино (Пете уже 16 и он вообще в шоке, что должен у тебя еще и разрешения спрашивать, ну да ладно, пусть идет).

Таким образом, Вася радостно зашнуровывает кроссовки, Дима с опущенной головой смотрит в окно на брата, который уже думает, сколько голов забьет сегодня (Дима получил команду disallow, то есть запрет). Ну а Петя отправляется в свое кино.

Из этого примера несложно понять, что Allow – это разрешение, а Disallow – запрет. Но в robots.txt мы не людям раздаем команды, а роботам, поэтому вместо конкретных дел там прописываются адреса страниц и каталогов, которые нужно разрешить или запретить индексировать.

Например, у меня есть сайт site.ru. Он на движке wordpress. Начинаю писать инструкции:

User-agent: * Disallow: /wp-admin/ Disallow: /wp-content/ Disallow: /wp-includes/ Allow: /wp-content/uploads/ Disallow: /source/ Ну и т.д.

User - agent : * Disallow : / wp - admin / Disallow : / wp - content / Disallow : / wp - includes / Disallow : / source / Нуит. д. |

Во-первых, я обратился ко всем роботам. Во-вторых, поставил запрет на индексацию папок самого движка, но при этом открыл роботу доступ к папке с загрузками. Там обычно хранятся все картинки, а их обычно не закрывают от индексации, если планируется получать трафик с поиска по картинкам.

Ну и помните, я ранее в статье говорил о том, что у вас могут быть дополнительные каталоги? Вы можете их создать самостоятельно для различных целей. Например, на одном из моих сайтов есть папка flash, куда я кидаю флэш-игры, чтобы потом их запустить на сайте. Либо source – в этой папке могут хранится файлы, доступные пользователям для загрузки.

В общем, абсолютно неважно, как называется папка. Если ее нужно закрыть, указываем путь к ней и команду Disallow.

Команда Allow нужна как раз для того, чтобы уже в закрытых разделах открыть какие-то части. Ведь по умолчанию, если у вас не будет файла robots.txt, весь сайт будет доступен к индексированию. Это и хорошо (уж точно что-то важное не закроете по ошибке), и в то же время плохо (будут открыты файлы и папки, которых не должно быть в выдаче).

Чтобы лучше понять этот момент, предлагаю еще раз просмотреть этот кусок:

Disallow: /wp-content/ Allow: /wp-content/uploads/

Disallow : / wp - content / Allow : / wp - content / uploads / |

Как видите, сначала мы ставим запрет на индексацию всего каталога wp-content. В нем хранятся все ваши шаблоны, плагины, но там же есть и картинки. Очевидно, что их то можно и открыть. Для этого нам и нужна команда Allow.

Дополнительные параметры

Перечисленные команды – не единственное, что можно указать в файле. Также есть такие: Host – указывает главное зеркало сайта. Кто не знал, у любого сайта по умолчанию есть два варианта написания его доменного имени: domain.com и www.domain.com.

Чтобы не возникло проблем, необходимо указать в качестве главного зеркала какой-то один вариант. Это можно сделать как в инструментах для веб-мастеров, как и в файле Robots.txt. Для этого пишем: Host: domain.com

Что это дает? Если кто-то попытается попасть на ваш сайт так: www.domain.com – его автоматически перекинет на вариант без www, потому что он будет признан главным зеркалом.

Вторая директива – sitemap. Я думаю вы уже поняли, что в ней задается путь к карте сайта в xml-формате. Пример: http://domain.com/sitemap.xml

Опять же, загрузить карту вы можете и в Яндекс.Вебмастере, также ее можно указать в robots.txt, чтобы робот прочитал эту строчку и четко понял, где ему искать карту сайта. Для робота карта сайта так же важна, как для Васи – мяч, с которым он пойдет на футбол. Это все равно, что он спрашивает у тебя (как у старшего брата) где мяч. А ты ему:

Задиваном

Теперь вы знаете, как правильно настроить и изменить robots.txt для яндекса и вообще любого другого поисковика под свои нужды.

Что дает настройка файла?

Об этом я также уже говорил ранее, но скажу еще раз. Благодаря четко настроенному файлу с командами для роботов вы сможете спать спокойнее зная, что робот не залезет в ненужный раздел и не возьмет в индекс ненужные страницы.

Я также говорил, что настройка robots.txt не спасает от всего. В частности, она не спасает от дублей, которые возникает из-за того, что движки несовершенны. Прям как люди. Вы то разрешили Васе идти на футбол, но не факт, что он там не натворит того же, что и Дима. Вот так и с дублями: команду дать можно, но точно нельзя быть уверенным, что что-то лишнее не пролезет в индекс, испортив позиции.

Дублей тоже не нужно бояться, как огня. Например, тот же Яндекс более менее нормально относится к сайтам, у которых серьезные технические косяки. Другое дело, что если запустить дело, то и вправду можно лишиться серьезного процента трафика к себе. Впрочем, скоро в нашем разделе, посвященном SEO, будет статья о дублях, тогда и будем с ними воевать.

Как мне получить нормальный robots.txt, если я сам ничего не понимаю?

В конце концов, создание robots.txt — это не создание сайта. Как-то попроще, поэтому вы вполне можете банально скопировать содержимое файла у любого более менее успешного блоггера. Конечно, если у вас сайт на WordPress. Если он на другом движке, то вам и сайты нужно искать на этих же cms. Как посмотреть содержимое файла на чужом сайте я уже говорил: Domain.com/robots.txt

Итог

Я думаю, тут больше не о чем говорить, потому что не надо делать составление инструкций для роботов вашей целью на год. Это та задача, которую под силу выполнить даже новичку за 30-60 минут, а профессионалу вообще всего-то за пару минут. Все у вас получиться и можете в этом не сомневаться.

А чтобы узнать другие полезные и важные фишки для продвижения и раскрутки блога, можете посмотреть наш уникальный . Если вы примените оттуда 50-100% рекомендаций, то сможете в будущем успешно продвигать любые сайты.

Всем привет! Начну с важного объявления. В нашем блоге запускается проект «Технический аудит под микроскопом » и данный материал открывает цикл статей, посвященных этой теме. О чем пойдет речь сегодня? О том, как правильно написать robots.txt для сайта с нуля.

Текст советую прочесть тем, кто хочет научиться создавать текстовый файл самостоятельно, и рассмотреть принцип его работы изнутри. Информация также пригодится владельцам веб-проектов, которые стремятся продвинуть свой сайт в ТОП.

В статье ниже «под микроскопом» рассмотрены такие вопросы:

Чтобы написать статью, я потратила около 37 часов, изучила более 20 источников, посетила несколько форумов веб-мастеров. Поэтому каждое слово неоднократно проверено и перепроверено.

Итак, начнем. Чтобы ввести вас в тему и дать общее представление о robots.txt, предлагаю по традиции обратиться к ассоциациям. Представьте, что вы владелец дома, и, как водится в частном секторе, к вам постоянно кто-то из соседей приходит в гости. Как вы можете поступить? Вообще не открывать дверь никому или впускать некоторых, которые более симпатичны. При этом вы можете предоставить в распоряжение гостей весь дом или только отдельные комнаты, закрыв все личные апартаменты.

По такому принципу и работает robots.txt: что-то для кого-то открывает, а куда-то кого-то не пускает. Подробности читайте дальше в статье.

Robots.txt: что значит и как работает

Знакомство с индексным файлом логично начать с объяснения термина.

Robots.txt – текстовый документ, который говорит поисковикам, на какие данные и страницы сайта обращать внимание (индексировать, обрабатывать), а на какие нет. Его еще называют «стандартом/протоколом исключений для роботов». Он действует для протоколов https, http и FTP, использует кодировку UTF-8 Unicode.

Практически все популярные поисковые системы следуют данным стандартам: Google, Ask, Yandex, AOL, Yahoo!, Bing и др. Хотя, стоит отметить, что Гугл воспринимает их, как «рекомендации», а не как «команду». То есть, как я понимаю, хочу придерживаюсь, хочу – нет.

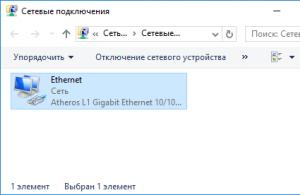

Где находится файл robots.txt? Его размещают в корневом каталоге веб-проекта. Визуально он выглядит так:

https://site.com.ua/robots.txt.

Принцип работы robots.txt

Говоря простыми словами, наличие robots.txt помогает установить диалог между веб-проектом и поисковыми системами (как переводчик на переговорах). При этом владелец ресурса сам решает, куда открыть доступ и куда запретить вход.

Таким образом, после сканирования индексного файла, развитие событий идет по одному из 3-х сценариев, т.е. поисковики получают:

- полный доступ ко всему веб-ресурсу;

- частичный пропуск, т.е. только к разрешенным страницам и данным;

- абсолютный запрет на вход, где сайт полностью закрыт для обработки.

Чтобы показать, как проходит индексация веб-проекта с robots.txt и без него, сделала инфографику.

Чтобы понять важность данного файла, нужно знать принцип работы поисковых систем. Итак, как же они действуют?

Робот поисковика заходит на сайт и первым делом ищет robots.txt. Если его нет или он составлен неправильно, то поисковая система начинает «руководить парадом» самостоятельно. То есть сканирует все подряд: и нужное, и ненужное. При таком подходе обработка веб-ресурса затягивается надолго и при этом не факт, что важные страницы будут первыми в очереди. Зачем такие сложности?

Кроме того, за 1 посещение роботы обрабатывают определенное число ресурсов. Какой из этого следует вывод? Меньше страниц для сканирования, больше проиндексированных и, следовательно, больше трафик. Быстрая индексация также помогает защитить новый контент и отследить, как те или иные мероприятия повлияли на позиции в выдаче.

5 основных директив для написания robots.txt

Прежде чем начать создавать файл robots.txt, нужно ознакомиться с основными командами (директивами), которые понадобятся для написания списка запретов.

Есть 5 базовых команд:

USER-AGENT

Указывает, для какого поисковика предназначаются команды, которые следуют после нее. Можно использовать символ «*» и тогда указания будут касаться всех поисковых систем. С этой директивы начинается любой индексный файл. Если она не прописана, поисковый робот считает, что все двери для него открыты.

Например:

User-agent: Google – команды для Гугл

User-agent: Yandex – команды для Яндекс

User-agent: * – команды для всех поисковиков

Обратите внимание, если робот обнаружил название своего поисковика после директивы User-agent, он проигнорирует все указания из раздела «User-agent: *».

Важно отметить, что поисковые системы имеют несколько роботов, для каждого из которых нужно прописывать команды отдельно.

Рассмотрим базовые роботы самых популярных поисковиков Гугл и Яндекс:

1. Google:

- Googlebot – основной робот поисковика;

- Googlebot-Image – сканирует изображения;

- Googlebot-Video – проверяет видеофайлы;

- Googlebot-Mobile – обрабатывает страницы для мобильных гаджетов;

- Adsbot-Google – проверяет качество рекламы на ресурсах для ПК;

- Googlebot-News – ищет страницы, чтобы добавить в Гугл Новости.

2. Yandex:

- Yandex – означает, что команды относятся ко всем роботам Яндекс;

- YandexBot – базовый бот поисковика;

- YandexImages

– обрабатывает картинки;

YandexNews – индексатор страниц, предназначенных для Яндекс Новости; - YandexMedia – сканирует мультимедийные данные;

- YandexMobileBot – проверяет документы на предмет верстки под мобильные девайсы.

Запомните, при написании файла robots.txt секции для разных ботов нужно разделять 1 пустой строкой.

В качестве памятки:

DISALLOW и ALLOW

Здесь все просто. Директива Allow разрешает поисковым ботам сканировать ресурс, Disallow – запрещает. Рассмотрим подробнее, как они работают.

Если в файле robots.txt прописать запрещающую команду Disallow или Allow, то можно:

- закрыть/открыть доступ роботов ко всему сайту, используя слэш;

Disallow: /

Allow: /

- запретить/разрешить сканирование определенных страниц, прописав адрес.

Disallow: /admin/

Allow: /admin/

- открыть/закрыть вход к конкретному файлу, указав путь:

Disallow: /razdel/file

Allow: /razdel/file

- запретить/разрешить обрабатывать документы определенного типа, используя *:

Disallow: /*png*

Allow: /*png*

Обратите внимание, чтобы закрыть/открыть страницы сайта для индексации, после данных директив robots.txt пишется не полный адрес, а лишь та часть, которая идет после домена сайта..

Как видите, все действительно просто. Как в математике: знаешь формулу – решишь задачу.

Чтобы закрепить материал, давайте разберем пример:

User-agent: *

Disallow: /

Allow: / blog/

Allow: / *.gift*

Что мы видим в фрагменте этого robots.txt: доступ открыт для всех поисковых систем, закрытыми для сканирования являются все страницы, кроме одного раздела «blog» и файлов типа «.gift».

Скачивайте картинку ниже, чтобы не забыть:

Что можно закрыть с помощью файла robots.txt и Disallow?

Все, конечно, зависит от пожеланий владельца веб-проекта, но есть несколько общих рекомендаций.

Посредством robots.txt советуют запретить индексацию ресурсов с:

- административной частью (иначе говоря, админку);

- личными данными пользователей;

- неполезным, неактуальным или неуникальным контентом (чек-лист для проверки);

- многоуровневыми формами регистрации, обратной связи, заказа и корзиной;

- тегами, результатами поиска по сайту, фильтрами.

Делаем вывод – в файле robots.txt нужно закрыть те страницы сайта, которые не важны, не нужны или не должны быть показаны пользователям и поисковикам.

Кстати, статья о контенте: «2 вида визуального контента »

SITEMAP

Еще один директив, который должен быть написан в файле robots.txt – Sitemap. Для чего он служит? Чтобы показать поисковым ботам путь к Карте сайта. Разберем вопрос в деталях.

Карта сайта – это файл в формате xml с кодировкой UTF8, который хранится в корневой директории веб-ресурса. Он представляет собой своеобразный каталог с ссылками, что ведут на разные страницы. При составлении Карты важно вносить только те ресурсы, которые нуждаются в индексе, исключая с динамическим URL и тегами.

Основные требования к файлу смотрите ниже:

Как директива Sitemap помогает в индексации?

Вспоминаем принцип работы поисковых ботов: зашли на сайт, откинули закрытые страницы и далее, если нет данной команды, начинают хаотично рыскать по сайту. Так как время на сканирование одного веб-проекта ограничено, робот может так и не дойти до действительно важных ресурсов. Особенно это касается «больших» сайтов, где много страниц и переходов по ссылкам.

Будет интересно прочесть: «Покупка вечных ссылок: 4 шага от хаоса к порядку »

Здесь как раз и приходит на помощь директива Sitemap. Она провожает робота к Карте сайта, где указано, какие ресурсы нужно проиндексировать и какие являются самыми важными, а также как часто должна обновляться информация. Такая индексация 100% более качественная и быстрее в 3,14 раза.

Вот как выглядит готовая Карта сайта (фрагмент):

Как создать Карту сайта?

Идеальный вариант воспользоваться бесплатными онлайн-генераторами.

Вот список протестированных мной сервисов:

- XML-Sitemaps.com. Бесплатно создает Sitemap для сайтов, содержащих до 500 страниц. Время работы – 2-3 минуты. Предлагает скачать файл в формате XML Document. Не требует регистрации. Интерфейс на английском языке.

- mysitemapgeneration . Для бесплатного пакета ограничение – до 500 страниц. Создание Карты сайта занимает всего пару минут. Готовый файл в формате xml отправляется на почту. Сайт русифицирован, простой и понятный. Регистрироваться не нужно.

- Xml Sitemap Generator . Англоязычный ресурс с лимитом до 2000 страниц. Скачать файл можно в нескольких форматах: xml, rss, html, txt. Создание Карты сайта проходит также быстро и без регистрации.

- Majento. Русскоязычный оперативный сайт, не требующий регистрации. Лимиты бесплатного пакета: до 1000 страниц, 5 раз/сутки для одного IP-адреса. Можно определить параметры отчета и установить фильтр на страницы с определенным расширением. Готовую Карту сайта можно скачать в формате xml.

Все сервисы справляются с созданием Sitemap на отлично. Кроме представленных онлайн-генераторов, есть также множество других: Small Seo Tools, Screamingfrog, xSitemap.com, Free Sitemap Generator и т.д. Выбирайте самый оптимальный для себя и делайте Карты сайта без проблем.

Узнайте также о 5 лучших сервисах для работы копирайтера с текстом

В готовом файле, кроме URL-адресов, вы увидите несколько команд, расшифровать которые поможет следующая картинка:

Карта сайта готова. Что дальше?

Нужно оповестить об этом поисковые системы. Конечно, поисковики со временем сами обнаружат этот файл, но для ускорения процесса лучше сразу показать им путь.

Вот 2 самых простых способа рассказать поисковым ботам о Карте сайта:

- Добавить ссылку на адрес файла, используя панель инструментов вебмастеров от Google и Yandex. В Яндекс.Вебмастер нужно: нажать на вкладку «Индексирование», далее на «Файлы Sitemap» и ввести URL. Для Гугл: открываем Google Search Console, кликаем на «Сканирование», затем на «Файлы Sitemap», вставляем и отправляем адрес.

- Вставить в файл robots.txt ссылку на месторасположение файла Sitemap. Визуально это выглядит так: Sitemap: https://site.com/sitemap.xml

Важный совет в заключении – желательно добавлять Sitemap после каждой публикации новой информации на сайте.

Как еще ускорить индексацию читайте:

«Как разместить и ускорить индексацию статьи? 5 секретов успеха »

HOST

Последней неотъемлемой частью robots.txt была директива Host. Она показывала поисковому роботу, какое зеркало (алиас) веб-проекта является основным: с префиксом www или без. Воспринималась данная команда только поисковиком Yandex и была актуальной исключительно для сайтов, имеющих «копии».

Примечание : зеркало сайта представляет собой полную или частичную копию интернет-проекта, которая имеет свой домен и находится на отдельном ресурсе.

Выглядело это примерно так:

Почему все в прошедшем времени, спросите вы. Ответ простой – 20 марта 2018 года Яндекс официально объявил про отказ от директивы Host. Теперь данная команда должна быть заменена редиректом 301 через файл.htaccess. Директиву Host нужно просто удалить из индексного файла. Хотя, если она присутствует, ничего страшного не произойдет, т.к. Яндекс теперь ее просто игнорирует.

Использование редиректа 301 для определения основного сайта является универсальным способом, т.к. воспринимается всеми поисковыми ботами. Детально, как поставить 301-й редирект будет рассказано в следующей статье. Следите за новинками в блоге, посещая сайт или через ленту новостей в

Robots.txt - это текстовый файл, который содержит параметры индексирования сайта для роботов поисковых систем.

Яндекс поддерживает следующие директивы:

| Директива | Что делает |

|---|---|

| User-agent * | |

| Disallow | |

| Sitemap | |

| Clean-param | |

| Allow | |

| Crawl-delay |

| Директива | Что делает |

|---|---|

| User-agent * | Указывает на робота, для которого действуют перечисленные в robots.txt правила. |

| Disallow | Запрещает индексирование разделов или отдельных страниц сайта. |

| Sitemap | Указывает путь к файлу Sitemap , который размещен на сайте. |

| Clean-param | Указывает роботу, что URL страницы содержит параметры (например, UTM-метки), которые не нужно учитывать при индексировании. |

| Allow | Разрешает индексирование разделов или отдельных страниц сайта. |

| Crawl-delay | Задает роботу минимальный период времени (в секундах) между окончанием загрузки одной страницы и началом загрузки следующей. |

* Обязательная директива.

Наиболее часто вам могут понадобиться директивы Disallow, Sitemap и Clean-param. Например:

User-agent: * #указываем, для каких роботов установлены директивы\nDisallow: /bin/ # запрещает ссылки из \"Корзины с товарами\".\nDisallow: /search/ # запрещает ссылки страниц встроенного на сайте поиска\nDisallow: /admin/ # запрещает ссылки из панели администратора\nSitemap: http://example.com/sitemap # указываем роботу на файл sitemap для сайта\nClean-param: ref /some_dir/get_book.pl

Роботы других поисковых систем и сервисов могут иначе интерпретировать директивы.

Примечание. Робот учитывает регистр в написании подстрок (имя или путь до файла, имя робота) и не учитывает регистр в названиях директив.

Использование кириллицы

Использование кириллицы запрещено в файле robots.txt и HTTP-заголовках сервера.

Приветствую вас, уважаемые читатели SEO блога Pingo. В данной статье я хочу изложить своё представление о том, как правильно составить robots.txt для сайта. В своё время меня очень раздражало, что информация в интернете по этому вопросу довольно отрывочна. Из-за этого приходилось ползать по большому количеству ресурсов, постоянно фильтруя повторяющуюся информацию и вычленяя новую.

Таким образом, здесь я постараюсь ответить на большинство вопросов, начиная с определения и заканчивая примерами реальных задач, решаемых данным инструментом. Если что-то забуду - отпишитесь в комментариях об этом - исследую вопрос и дополню материал.

Robots.txt - что это, зачем нужен и где обитает?

Итак, сперва ликбез для тех, кому данная тема незнакома совершенно.

Robots.txt - текстовый файл, содержащий инструкции по индексации сайта для роботов поисковых систем. В этом файле вебмастер может определить параметры индексации своего сайта как для всех роботов сразу, так и для каждой поисковой системы по отдельности (например, для гугла).

Где находится robots.txt? Он размещается в корневой папке FTP сайта, и, по сути, является обычным документом в формате txt, редактирование которого можно осуществлять через любой текстовый редактор (лично я предпочитаю Notepad++). Содержимое файла роботс можно увидеть, введя в адресной строке браузера http://www.ваш-сайт.ru/robots.txt. Если, конечно, он существует.

Как создать robots.txt для сайта? Достаточно сделать обычный текстовый файл с таким именем и загрузить его на сайт. О том, как его правильно настроить и составить, будет сказано ниже.

Структура и правильная настройка файла robots.txt

Как должен выглядеть правильный файл robots txt для сайта? Структуру можно описать следующим образом:

1. Директива User-agent

Что писать в данном разделе? Эта директива определяет то, для какого именно робота предназначены нижеизложенные инструкции. Например, если они предназначены для всех роботов, то достаточно следующей конструкции:

В синтаксисе файла robots.txt знак «*» равноценен словосочетанию «что угодно». Если же требуется задать инструкции для конкретной поисковой системы или робота, то на месте звездочки из предыдущего примера пишется его название, например:

User-agent: YandexBot

У каждого поисковика существует целый набор роботов, выполняющих те или иные функции. Роботы поисковой системы Яндекс описаны . В общем же плане имеется следующее:

- Yandex - указание на роботов Яндекс.

- GoogleBot - основной индексирующий робот .

- MSNBot - основной индексирующий робот Bing.

- Aport - роботы Aport.

- Mail.Ru - роботы ПС Mail.

Если имеется директива для конкретной поисковой системы или робота, то общие игнорируются.

2. Директива Allow

Разрешает отдельные страницы раздела, если, скажем, ранее он целиком закрыт от индексации. Например:

User-agent: *

Disallow: /

Allow: /открытая-страница.html

В данном примере мы запрещаем к индексации весь сайт, кроме страницы poni.html

Служит эта директива в какой-то степени для указания на исключения из правил, заданных директивой Disallow. В случае, если таких ситуаций нет, то директива может не использоваться совсем. Она не позволяет открыть сайт для индексации, как многие думают, так как если нет запрета вида Disallow: /, то он открыт по умолчанию.

2. Директива Disallow

Является антиподом директивы Allow и закрывает от индексации отдельные страницы, разделы или сайт целиком. Являет аналогом тега noindex. Например:

User-agent: *

Disallow: /закрытая-страница.html

3. Директива Host

Используется только для Яндекса и указывает на основное зеркало сайта. Выглядит это так.

Основное зеркало без www:

Основное зеркало с www:

Host: www.site.ru

Сайт на https:

Host: https://site.ru

Нельзя записывать директиву host в файл дважды. Если же вследствие какой-то ошибки это произошло, то обрабатывается та директива, которая идет первой, а вторая - игнорируется.

4. Директива Sitemap

Используется для указания пути к XML-карте сайта sitemap.xml (если она есть). Синтаксис следующий:

Sitemap: http://www.site.ru/sitemap.xml

5. Директива Clean-param

Используется для закрытия от индексации страниц с параметрами, которые могут являться дублями. Очень полезная на мой взгляд директива, которая отсекает параметрический хвост урлов, оставляя только костяк, который и является родоначальным адресом страницы.

Особенно часто встречается такая проблема при работе с каталогами и интернет-магазинами.

Скажем, у нас имеется страница:

http://www.site.ru/index.php

И эта страница в процессе работы может обрастать клонами вида.

http://www.site.ru/index.php?option=com_user_view=remind

http://www.site.ru/index.php?option=com_user_view=reset

http://www.site.ru/index.php?option=com_user_view=login

Для того, чтобы избавиться от всевозможных вариантов этого спама, достаточно указать следующую конструкцию:

Clean-param: option /index.php

Синтаксис из примера, думаю, понятен:

Clean-param: # указываем директиву

option # указываем спамный параметр

/index.php # указываем костяк урла со спамным параметром

Если параметров несколько, то просто перечисляем их через амперсант(&):

http://www.site.ru/index.php?option=com_user_view=remind&size=big # урл с двумя параметрами

Clean-param: option&big /index.php # указаны два параметра через амперсант

Пример взят простой, поясняющий саму суть. Особенно спасибо этому параметру хочется сказать при работе с CMS Bitrix.

Директива Crawl-Delay

Позволяет задать таймаут на загрузку страниц сайта роботом Яндекс. Используется при большой загруженности сервера, при которой он просто не успевает быстро отдавать содержимое. На мой взгляд, это анахронизм, который уже не учитывается и который можно не использовать.

Crawl-delay: 3.5 #таймаут в 3,5 секунды

Синтаксис

- # - используется для написания комментариев:

- * - означает любую последовательность символов, значение:

- $ - обрезание правила, антипод знака звездочки:

User-agent: * # директива относится ко всем роботам

Disallow: /page* # запрет всех страниц, начинающихся на page

Disallow: /*page # запрет всех страниц, заканчивающихся на page

Disallow: /cgi-bin/*.aspx # запрет всех aspx страниц в папке cgi-bin

Disallow: /page$ # будет закрыта только страница /page, а не /page.html или pageline.html

Пример файла robots.txt

С целью закрепления понимания вышеописанной структуры и правил, приведем стандартный robots txt для CMS Data Life Engine.

User-agent: * # директивы предназначены для всех поисковых систем

Disallow: /engine/go.php # запрещаем отдельные разделы и страницы

Disallow: /engine/download.php #

Disallow: /user/ #

Disallow: /newposts/ #

Disallow: /*subaction=userinfo # закрываем страницы с отдельными параметрами

Disallow: /*subaction=newposts #

Disallow: /*do=lastcomments #

Disallow: /*do=feedback #

Disallow: /*do=register #

Disallow: /*do=lostpassword #

Host: www.сайт # указываем главное зеркало сайта

Sitemap: https://сайт/sitemap.xml # указываем путь до карты сайта

User-agent: Aport # указываем направленность правил на ПС Aport

Disallow: / # предположим, не хотим мы с ними дружить

Проверка robots.txt

Как проверить robots txt на корректность составления? Стандартный вариант - валидатор Яндекса - http://webmaster.yandex.ru/robots.xml . Вводим путь до вашего файла роботс или сразу вставляем его содержимое в текстовое поле. Вводим список урлов, которые мы хотим проверить - закрыты или открыты они согласно заданным директивам - нажимаем «Проверить» и вуаля! Профит.

Выводится статус страницы - открыта ли она для индексации или закрыта. Если закрыта, то указывается, каким именно правилом. Чтобы разрешить индексацию такой страницы, нужно доработать правило, на которое указывает валидатор. Если в файле имеются синтаксические ошибки, то валидатор также об этом сообщит.

Генератор robots.txt - создание в режиме онлайн

Если изучать синтаксис желания или времени нет, но необходимость закрыть спамные страницы сайта присутствует, то можно воспользоваться любым бесплатным онлайн генератором , который позволит создать robots txt для сайта всего парой кликов. Затем вам останется лишь скачать файл и загрузить его к себе на сайт. При работе с ним вам лишь необходимо проставить галочки у очевидных настроек, а также указать страницы, которые вы хотите закрыть от индексации. Остальное генератор сделает за вас.

Готовые файлы для популярных CMS

Файл robots.txt для сайта на 1C Битрикс

User-Agent: *

Disallow: /bitrix/

Disallow: /personal/

Disallow: /upload/

Disallow: /*login*

Disallow: /*auth*

Disallow: /*search

Disallow: /*?sort=

Disallow: /*gclid=

Disallow: /*register=

Disallow: /*?per_count=

Disallow: /*forgot_password=

Disallow: /*change_password=

Disallow: /*logout=

Disallow: /*back_url_admin=

Disallow: /*print=

Disallow: /*backurl=

Disallow: /*BACKURL=

Disallow: /*back_url=

Disallow: /*BACK_URL=

Disallow: /*ADD2BASKET

Disallow: /*ADD_TO_COMPARE_LIST

Disallow: /*DELETE_FROM_COMPARE_LIST

Disallow: /*action=BUY

Disallow: /*set_filter=y

Disallow: /*?mode=matrix

Disallow: /*?mode=listitems

Disallow: /*openstat

Disallow: /*from=adwords

Disallow: /*utm_source

Host: www.site.ru

Robots.txt для DataLife Engine (DLE)

User-agent: *

Disallow: /engine/go.php

Disallow: /engine/download.php

Disallow: /engine/classes/highslide/

Disallow: /user/

Disallow: /tags/

Disallow: /newposts/

Disallow: /statistics.html

Disallow: /*subaction=userinfo

Disallow: /*subaction=newposts

Disallow: /*do=lastcomments

Disallow: /*do=feedback

Disallow: /*do=register

Disallow: /*do=lostpassword

Disallow: /*do=addnews

Disallow: /*do=stats

Disallow: /*do=pm

Disallow: /*do=search

Host: www.site.ru

Sitemap: http://www.site.ru/sitemap.xml

Robots.txt для Joomla

User-agent: *

Disallow: /administrator/

Disallow: /cache/

Disallow: /includes/

Disallow: /installation/

Disallow: /language/

Disallow: /libraries/

Disallow: /media/

Disallow: /modules/

Disallow: /plugins/

Disallow: /templates/

Disallow: /tmp/

Disallow: /xmlrpc/

Disallow: *print

Disallow: /*utm_source

Disallow: /*mailto*

Disallow: /*start*

Disallow: /*feed*

Disallow: /*search*

Disallow: /*users*

Host: www.site.ru

Sitemap: http://www.site.ru/sitemap.xml

Robots.txt для Wordpress

User-agent: *

Disallow: /cgi-bin

Disallow: /wp-admin

Disallow: /wp-includes

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: */trackback

Disallow: */feed

Disallow: /wp-login.php

Disallow: /wp-register.php

Host: www.site.ru

Sitemap: http://www.site.ru/sitemap.xml

Robots.txt для Ucoz

User-agent: *

Disallow: /a/

Disallow: /stat/

Disallow: /index/1

Disallow: /index/2

Disallow: /index/3

Disallow: /index/5

Disallow: /index/7

Disallow: /index/8

Disallow: /index/9

Disallow: /panel/

Disallow: /admin/

Disallow: /secure/

Disallow: /informer/

Disallow: /mchat

Disallow: /search

Disallow: /shop/order/

Disallow: /?ssid=

Disallow: /google

Disallow: /